- Google DeepMind이 Gemma 4를 Apache 2.0 라이선스로 전면 공개 — 상업적 제한 제로

- 31B Dense 모델이 LMArena 텍스트 리더보드 3위, 26B MoE는 4B만 활성화하고도 6위 달성

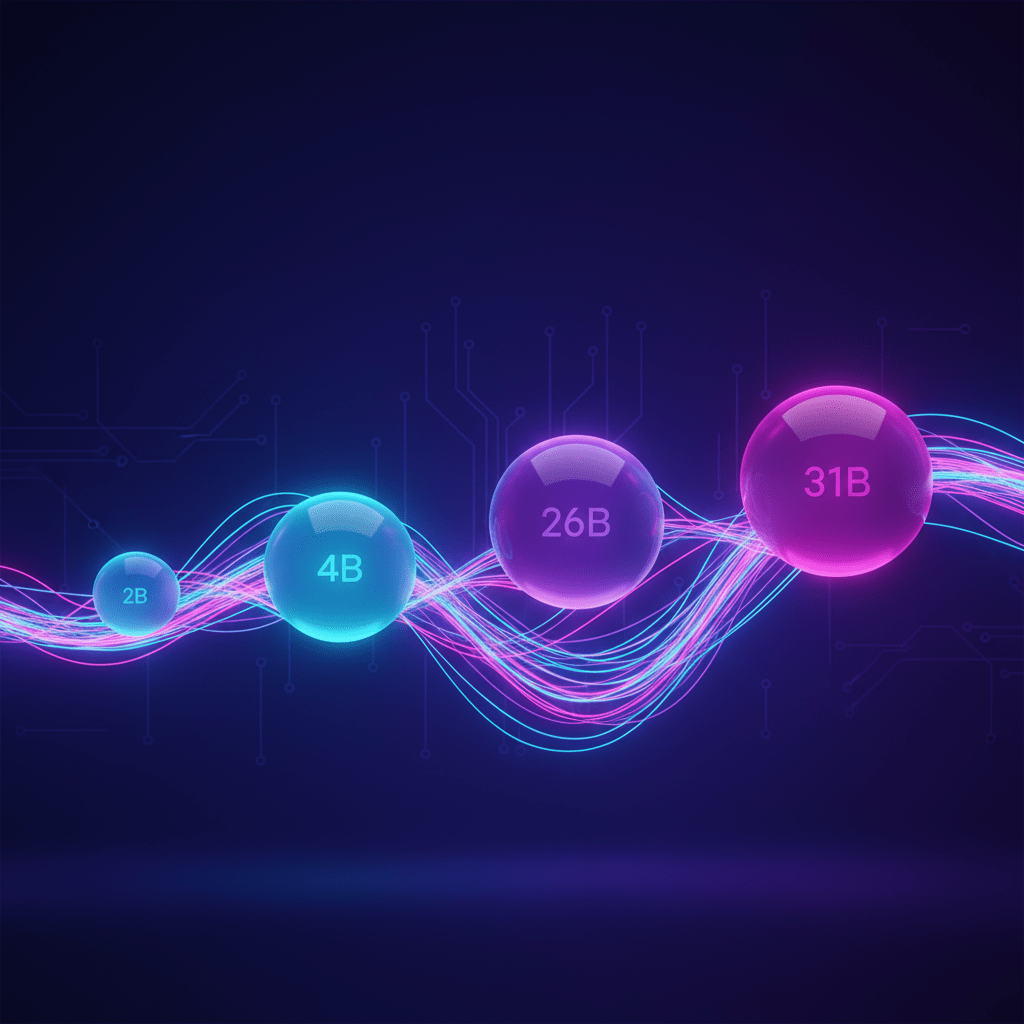

- E2B(2.3B)부터 31B까지 4종 동시 출시 — 스마트폰에서 서버까지 전 구간 커버

- 텍스트, 이미지, 오디오, 영상 4개 모달리티 네이티브 지원 + 최대 256K 컨텍스트 윈도우

오픈소스 AI의 기준이 다시 쓰여졌다. Google DeepMind이 4월 2일 공개한 Gemma 4는 31B 파라미터만으로 수백억 규모 상용 모델들과 정면 대결해 LMArena 3위에 올랐다. Apache 2.0 라이선스라 수정, 배포, 상업 이용에 제한이 없다. 스타트업부터 대기업까지, 이 모델을 무시할 수 없는 이유를 분석한다.

4종 라인업 — 스마트폰부터 데이터센터까지

모델 스펙 한눈에 보기

Gemma 4는 네 가지 사이즈로 동시 출시됐다. E2B(실효 2.3B, 총 5.1B)와 E4B(실효 4.5B, 총 8B)는 128K 컨텍스트 윈도우를 갖춘 Dense 모델로 스마트폰과 라즈베리파이에서도 돌아간다. 26B A4B는 총 26B 파라미터 중 추론 시 4B만 활성화하는 Mixture-of-Experts(MoE) 구조로 256K 컨텍스트를 지원한다. 플래그십 31B Dense는 256K 컨텍스트와 함께 MMLU Pro 85.2%, AIME 2026 89.2%, GPQA Diamond 84.3%를 기록했다.

효율성의 핵심 — MoE와 Shared KV Cache

26B MoE 모델은 추론 시 6.5배 적은 파라미터만 활성화하면서 31B Dense와 근접한 성능을 낸다. 여기에 Shared KV Cache 기술로 마지막 N개 레이어가 이전 레이어의 키-밸류 프로젝션을 재사용해 메모리와 연산량을 동시에 절감한다. 긴 문맥과 온디바이스 추론에서 특히 강력하다.

AI Biz Insider 분석 ― 26B MoE가 4B 활성 파라미터만으로 LMArena 6위를 찍었다는 건 곧 모바일/엣지 디바이스에서 ‘서버급 추론’이 가능해졌다는 의미다. 클라우드 API 종속 없이 자체 모델을 돌리려는 기업에게 게임 체인저가 될 수 있다.

멀티모달 네이티브 — 텍스트만의 시대는 끝났다

4개 모달리티 + 140개 언어

소형 모델(E2B, E4B)은 텍스트, 이미지, 오디오, 영상을 모두 처리한다. 대형 모델(26B, 31B)은 오디오를 제외한 텍스트, 이미지, 영상을 지원한다. 비전 인코더는 원본 종횡비를 유지하면서 이미지당 70~1,120개 토큰 예산을 설정해 속도-메모리-품질 트레이드오프를 조절할 수 있다. MMMU Pro 76.9%, MATH-Vision 85.6%로 멀티모달 벤치마크에서도 최상위권을 기록했다.

코딩 성능 — Codeforces ELO 2150

31B 모델은 LiveCodeBench v6에서 80.0%, Codeforces ELO 2150을 기록했다. 이는 상위 경쟁 프로그래머 수준이다. HLE(Humanity’s Last Exam) 벤치마크에서도 도구 없이 19.5%, 검색 활용 시 26.5%를 달성해 복잡한 추론 작업에서의 강점을 입증했다.

AI Biz Insider 분석 ― Gemma 4의 진짜 파괴력은 Apache 2.0에 있다. Llama 시리즈가 커뮤니티 라이선스로 상업적 제한을 두는 반면, Gemma 4는 완전한 수정-배포-상업화 자유를 보장한다. 스타트업 입장에서 라이선스 리스크 없이 파인튜닝해서 프로덕션에 바로 넣을 수 있다는 것은 결정적 차별점이다.

아키텍처 혁신 3가지

첫째, Per-Layer Embeddings(PLE)이다. 두 번째 임베딩 테이블이 모든 디코더 레이어에 잔차 신호를 제공해 레이어별 특화 컨디셔닝을 수행한다. 둘째, Alternating Attention 패턴이다. 로컬 슬라이딩 윈도우(512~1024 토큰)와 글로벌 풀 컨텍스트 어텐션 레이어를 교대 배치해 효율성과 장문 처리를 동시에 잡았다. 셋째, Dual RoPE 설정이다. 슬라이딩 윈도우 레이어에는 표준 RoPE, 글로벌 레이어에는 프루닝된 RoPE를 적용해 256K까지의 긴 컨텍스트를 안정적으로 지원한다.

배포 생태계 — 어디서든 돌린다

HuggingFace Transformers, llama.cpp, MLX(Apple Silicon), transformers.js(WebGPU), ONNX, Vertex AI까지 주요 추론 프레임워크를 모두 지원한다. 파인튜닝은 TRL, Unsloth Studio, Vertex AI에서 가능하다. llama.cpp를 쓰면 brew install 한 줄로 OpenAI 호환 API 서버를 즉시 띄울 수 있고, MLX로는 Apple Silicon Mac에서 네이티브 추론이 가능하다. Extended Thinking 기능도 enable_thinking=True 한 줄로 활성화된다.

관련 글

- 같은 날 같은 걸 냈다…OpenAI와 Google 사이에 무슨 일이?

- 13GB로 GPT-4 이겼다는 모델…써봤더니 소름

- AI 에이전트 성공률 1년 만에 4배…스탠퍼드 423페이지가 말하는 현실

- Mac 유저 전원 해당. Google이 어제 한 짓

출처

- Google Blog – Gemma 4: Byte for byte, the most capable open models (2026.04.02)

- HuggingFace Blog – Welcome Gemma 4: Frontier multimodal intelligence on device

AI Biz Insider · AI 트렌드 · aibizinsider.com

댓글 남기기