- Vol.01에서 “클라우드 AI를 못 쓴다”고 결론 내린 제조 기업이 지금 답해야 할 질문은 하나: “어느 온프레미스 LLM을 사내 GPU에 올릴 것인가?”

- 2026년 4월 현재 현실적 후보는 4개: Meta Llama 4 · Alibaba Qwen 3 · Naver HyperClova X · Mistral Large 3. 각각 강점이 다르다.

- 한국어 품질·한국 데이터 최적화는 HyperClova X 압도적(HAE-RAE Bench 84.14). 글로벌 범용은 Llama 4(10M context)·Qwen 3(92언어). 비용 효율은 Mistral Medium 3.

- 하드웨어: 70B 클래스는 H100 8장(2~4억 원) 필요. 소형 모델(8B 이하)은 A100 2장으로 가능. CAD 검증·BOM 분석에는 소형부터 POC 권장.

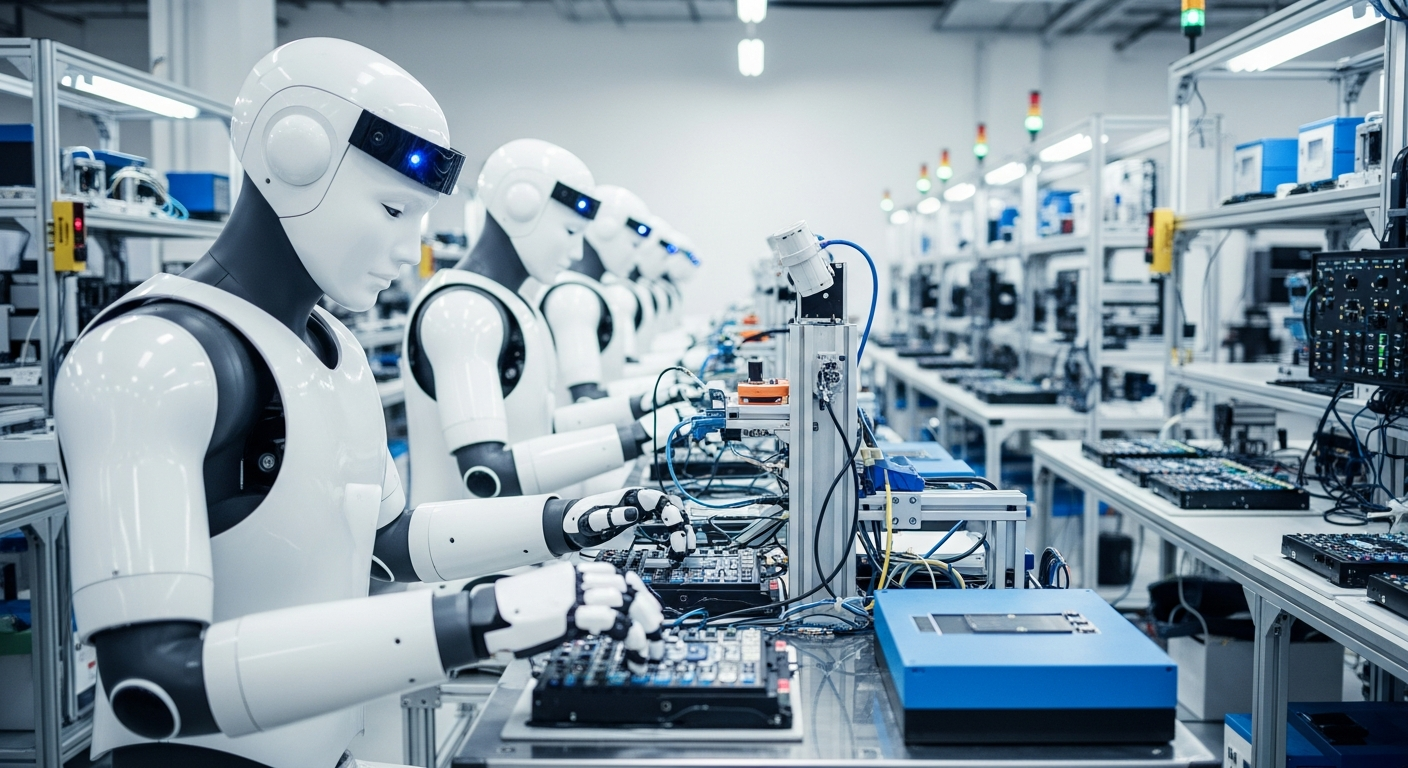

지난 리포트(Vol.01)에서 “한국 제조업은 도면·BOM·원가를 클라우드 AI로 보낼 수 없다”는 현실을 다뤘다. 그 결론이 옳다면 다음 질문은 자연스럽다. 그렇다면 어느 온프레미스 LLM을 사내에 설치할 것인가.

2026년 4월 현재 이 질문에 답할 수 있는 현실적 후보는 4개뿐이다. Meta의 Llama 4, Alibaba의 Qwen 3, Naver의 HyperClova X, Mistral의 Large 3. 각각 라이선스·성능·한국어 품질·하드웨어 요구가 다르다. 이 리포트는 선택 기준 5가지와 용도별 추천을 정리한다.

선택 기준 5가지

모델 비교 전에 프레임이 필요하다. 공장에 AI를 도입하는 기업이 실제로 따져야 할 5가지 축은 다음과 같다.

4개 모델 전수 비교

공식 발표 기준으로 정리한 2026년 4월 스냅샷이다. 세부 수치는 모델 버전·배포 형태에 따라 달라질 수 있다.

AI Biz Insider 분석 ― 표만 보면 HyperClova X가 한국어 특화로 독보적이다. 그러나 라이선스가 엔터프라이즈 계약 기반이라 비용·협상이 필요하다. 반면 Llama 4·Qwen 3은 가중치 공개 + 상업 라이선스라 당장 다운로드해 사내에 돌릴 수 있다. “접근성”과 “품질”의 트레이드오프가 선택의 첫 축이다.

하드웨어 요구사항 — 얼마가 드는가

온프레미스 LLM의 실질적 장벽은 모델 자체가 아니라 하드웨어다. 모델 크기별 GPU 구성과 구축 비용을 정리하면 다음과 같다.

가성비 전략: “작게 시작하고 확장하라”

많은 기업이 처음부터 70B 대형 모델을 도입하려다 초기 비용에 좌절한다. 실무 관점에서 권장되는 순서는 다음과 같다:

- 1단계 — 소형 POC: 1~3B 모델 + A100 1장으로 특정 업무(예: CAD 검증) 3개월 테스트. 투자 3,000만 원 이내.

- 2단계 — 중형 확대: 효과 확인되면 7~14B 모델 + A100 2장. 동시 50명 사용 가능. 1억 원 이내.

- 3단계 — 대형 전환: 전사 적용 결정 시 70B + H100 8장. 이때도 이미 1~2단계에서 워크플로우·데이터 준비 끝나 있어야 함.

용도별 최적 선택

“어느 모델이 최고냐”는 틀린 질문이다. “우리 용도에 어느 모델이 맞냐”가 맞는 질문이다. PLM 구축 현장에서 관찰되는 대표 5가지 업무별 추천.

CAD 치수·공차 검증

이전 버전과 변경 후 버전의 치수 일관성 자동 체크. 한국어 설명 품질보다 정밀한 논리 추론이 중요.

설계 변경 이력 요약

ECO/ECN 승인 요청서 자동 작성. 한국어 보고서 톤·공문 형식이 핵심.

BOM 변경 영향 분석

품번 하나가 바뀌면 어느 완성품에 영향이 가는지 자동 추적. 대규모 테이블 이해 필수.

협력사 이메일 분류·요약

도면 회신·이슈·납기 문의 자동 태깅. 소형 모델로도 충분.

품질 부적합 보고서 분류 + 유사 사례 검색

새 부적합 보고서가 들어오면 과거 10년치 유사 사례를 자동 검색 + 근본 원인 후보 제시. RAG 파이프라인 필수.

구축 체크리스트 — 발주 전 확인할 것

GPU 발주 전, 모델 다운로드 전, 이 10개 질문에 답이 있어야 실패하지 않는다.

- 우리 업무 텍스트 중 한국어 비중 (%)

- 평균 문서 길이 (토큰)

- 동시 사용자 예상 수

- 응답 지연 허용 (초)

- 파인튜닝 필요 여부

- 3년 TCO (HW + 전력 + 인건비)

- 라이선스 재판매·재배포 제약

- 서버실 냉각·전력 증설 필요 여부

- 모델 업데이트 책임자 지정

- 보안 감사 로그 요구사항

현장에서 본 5가지 시행착오

Papsnet이 PLM·MES 구축 경험에서 관찰한 온프레미스 AI 도입 초기 단계의 공통 실수.

- ① 처음부터 70B 모델: “좋은 모델 사자”는 임원 지시로 H100 8장 먼저 사고, 이후 실제로 쓰는 건 3B로 충분했다는 결론이 6개월 뒤에 나온다. 하드웨어 유휴 상태.

- ② 한국어 품질 테스트 없이 Llama 선택: 영문 벤치마크만 보고 결정. 실제 사내 문서로 돌려보면 번역 톤이 어색해 사용 저조.

- ③ RAG 없이 “모델만 돌리면 된다”: 모델은 도입했는데 사내 도면·BOM 인덱싱 없어 그냥 일반 LLM처럼 쓰다가 가치 못 느낌.

- ④ 라이선스 약관 미확인: Llama Community 라이선스의 “MAU 7억” 조항이나 Mistral 상업 버전 요금을 법무 검토 없이 배포 후 문제 발생.

- ⑤ 책임자 미지정: 모델은 6개월마다 업데이트 필요. 누가 모니터링·재학습·보안 패치 할지 정하지 않으면 6개월 후 구버전 방치.

결론 — 세 가지 상황별 추천

“최고의 모델”은 없다. 우리 업무 특성에 가장 잘 맞는 모델이 있을 뿐이다. 그리고 그걸 찾으려면 2개월 POC를 돌려봐야 안다. 발주부터 하면 늦는다.

다음 월간 리포트 Vol.03에서는 실제 POC 설계법을 다룬다. “1개월 3,000만 원으로 온프레미스 LLM을 제대로 평가하는 방법 — POC 계획서 템플릿과 평가 지표 10가지”.

출처 · 방법론

- Meta Llama Models GitHub Repository — Llama 3.3 / 4 모델 사양

- Llama 공식 사이트 — 라이선스 및 사용 정책

- Qwen 공식 블로그 — Qwen 3 모델 패밀리

- Naver HyperClova X — SEED 라인업 및 벤치마크

- Mistral AI Technology — Large 3 · Medium 3 · Ministral 3

- Papsnet PLM 구축 고객사 관찰 (30+ 현장, 2015~2026) — 업종·규모로만 익명 처리

- NVIDIA H100 · A100 가격 자료 (공식 파트너 견적 기준)

관련 글

- 월간 리포트 Vol.01 — 숫자 하나에 공장이 휘청인다: 한국 제조업 AI 장벽과 돌파구

- MCP vs Skills: 무엇이 다르고, 왜 중요한가 — 원문 분석

- 대한민국 인공지능행동계획 확정, 99개 실행과제로 AI 3강 도약 청사진

- AI 기본법 시행 3개월 현황, 고영향 AI 판단 기준과 과태료 체계

- 에이전틱 AI 얼라이언스 출범, 250개 기관 참여 민관 협력체 완전 분석

AI Biz Insider · AI 비즈니스 · aibizinsider.com

발행 2026-04-15 · 편집장 K.Nardo (킴날도) · 리포트 문의 kimnardo98@gmail.com

댓글 남기기